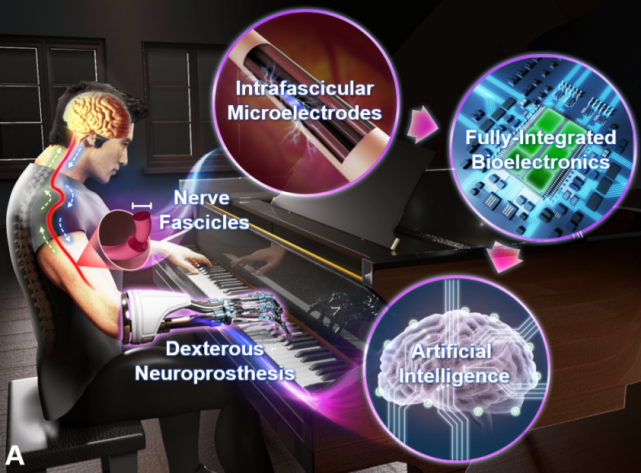

近年来,基于深度学习的神经解码器已成为实现神经假肢灵巧、直觉控制的主要方法。人类甚至已经设想出了这种假肢在医学领域的广泛应用图景。

然而,由于深度学习对计算的要求很高,很少有研究将其应用于临床。边缘计算设备的发展为解决这一问题提供了可能。

在一篇新论文中,来自明尼苏达大学等机构的研究者提出了一种基于嵌入式深度学习控制的神经假肢实现。该研究中的神经解码器基于 RNN 架构设计,部署在 NVIDIA Jetson Nano 上。NVIDIA Jetson Nano 拥有不错的 AI 算力,但体格非常小巧,这使得假肢安装者可以实时控制每一根手指,同时还能自由移动。

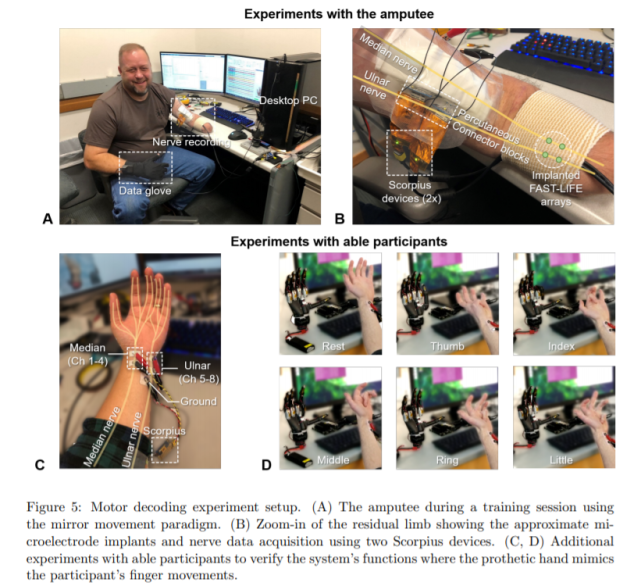

研究者利用外周神经信号在桡骨截肢的志愿者身上评估所提出的系统。实验结果显示,无论是在实验室还是真实环境下,该系统都能提供鲁棒、准确(95-99%)、低延迟(50-120 毫秒)的单个手指控制。

研究者表示,据他们所知,该系统是第一个在临床神经假肢应用的便携式平台上有效实现深度学习神经解码器的系统。这种新型假肢系统拥有嵌入式人工智能,可以作为新型可穿戴生物医学设备的基础,有助于加快深度神经网络在临床应用中的部署。

论文链接: https://arxiv.org/pdf/2103.13452.pdf

这一成果离不开之前研究取得的进展,包括 Overstreet 等人 2019 年提出的连接神经纤维和生物电子系统的神经束内微电极阵列;Nguyen 等人 2020 年设计的能同时展开神经记录和刺激的 Neuronix 神经接口微芯片;Luu 等人 2021 年提出的降低解码器计算复杂度的深度学习电机解码范式优化;以及 SOTA 边缘计算平台的软硬件实现等。

系统概览

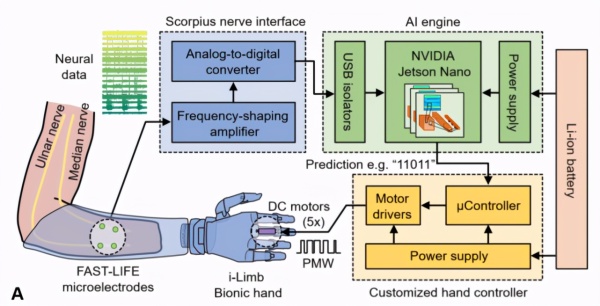

下图展示了研究者提出的神经假肢神经解码器的大体构造:

该系统包含 Scorpius 神经接口、带有定制载板的 Jetson Nano、定制的手臂控制器以及一个可多次充电的锂电池。

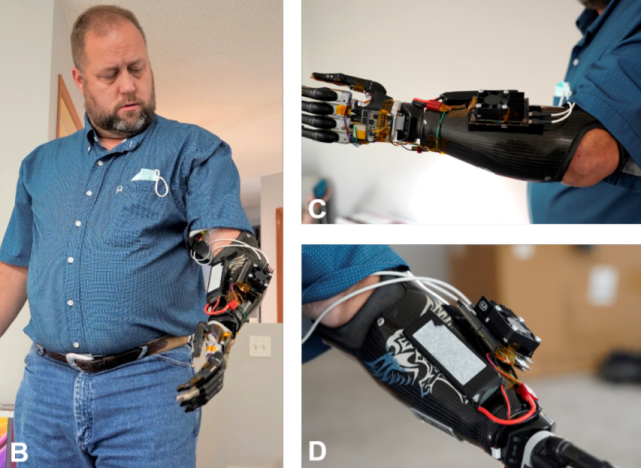

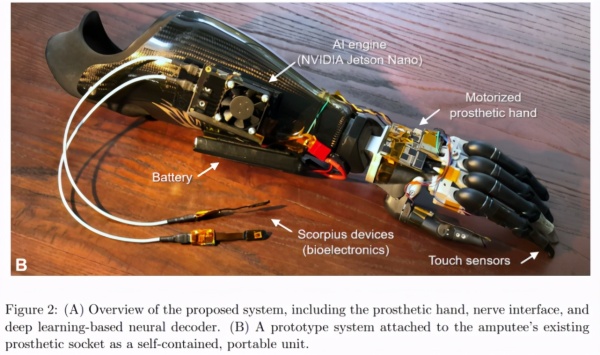

下图是该系统的原型图。AI 引擎重 90 克,锂电池(7.4V,2200mAh)重 120 克。在实际应用中,整个系统都可以集成到假肢内部,替代假肢现有的 ENG 传感器和电子设备,因此对手臂的重量和美感影响极小。

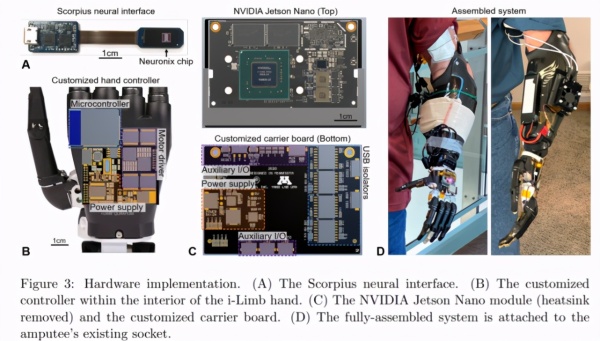

神经数据是通过研究者之前提出的 Scorpius 神经接口获得的。每个 Scorpius 设备有 8 个记录通道,配有频率整形(FS)放大器和高精度模数转换器(ADC)。根据需要的通道数量,可以配置多个设备。FS 神经记录器被证明能够在抑制 artifact 的同时获得超低噪声神经信号。原始的神经数据会直接传输到 Jetson Nano 电脑进行进一步处理。

该系统的核心是由Jetson Nano 平台支撑的 AI 引擎。研究者设计了一个定制的载板为 Nano 模块提供电源管理和 I/O 连接。该模块可工作在 10W 模式 (4 核 CPU 1900 MHz,GPU 1000 GHz) 或 5W 模式 (2 核 CPU 918 MHz,GPU 640 MHz) 下,按当前电池尺寸,可分别连续使用 2 小时和 4 小时左右。

在这个系统中,训练好的深度学习模型被部署到 AI 引擎上,实时地将神经信号转化为个体手指运动的真实意图。最后的预测被发送到手部控制器来驱动假手。

这个假手是基于英国科技公司 Touch Bionics 的 i-Limb 假肢平台设计的,有五个单独驱动的手指。研究者用定制的手部控制器替换了原来的 i-Limb 默认驱动器,从而根据深度学习模型的预测,直接操作隐藏在每根手指中的直流电机。该控制器是围绕 ESP32 模块设计的,带有一个低功耗微控制器。

下图 3 更详细地展示了各个组件的硬件实现:

关于该研究的更多细节可以参考原论文。